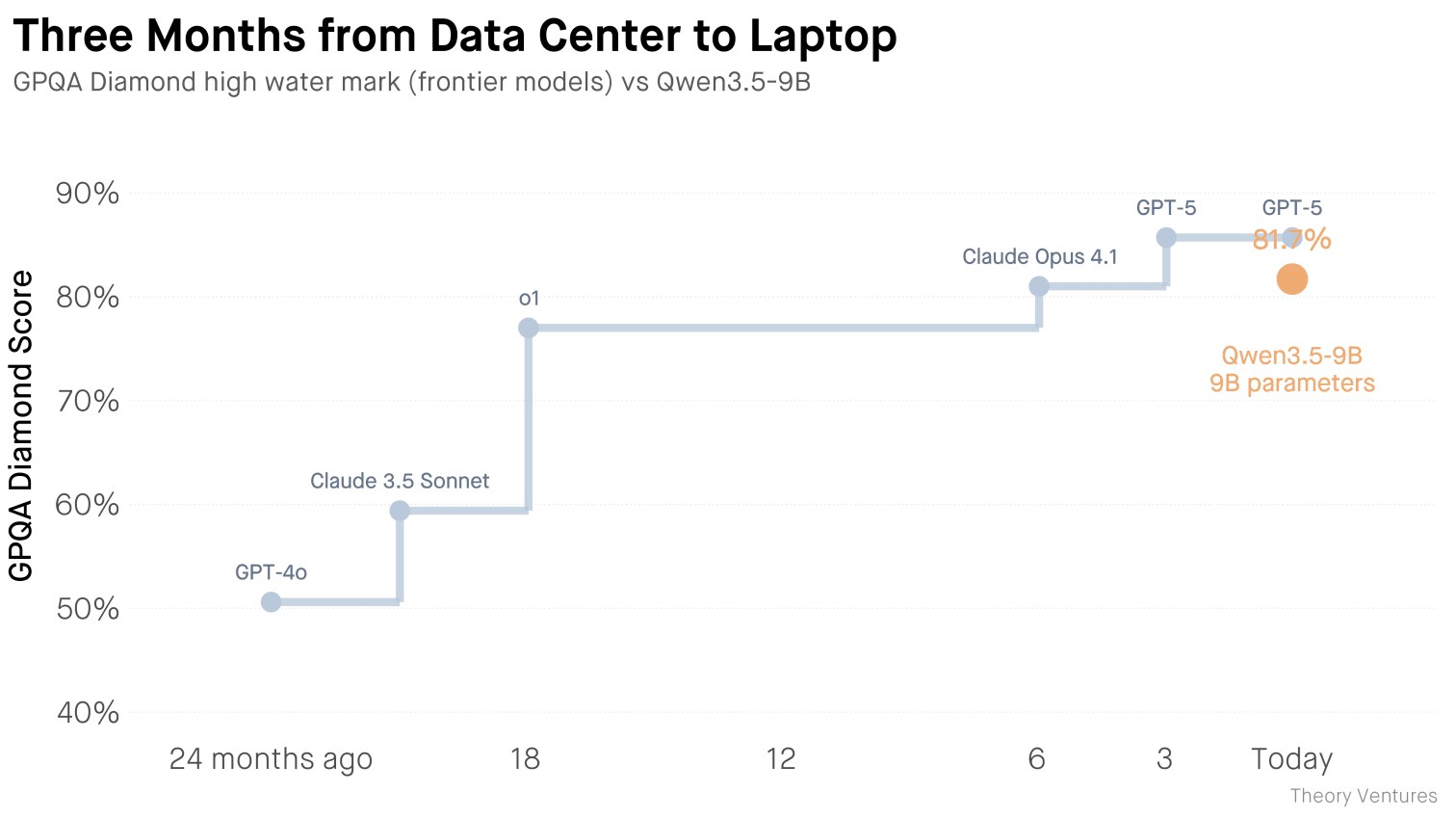

Alibaba выпустила открытый LLM Qwen‑3.5‑9B (9 млрд параметров), который влезает в 12 ГБ ОЗУ и работает на ноутбуке стоимостью около $5 000. При среднем потреблении 20 млн токенов в сутки такие «монстры» окупаются после примерно 556 млн токенов – то есть за месяц.

Облачные API (Claude, OpenAI) берут ≈$9 за миллион токенов. При тех же 20 млн токенов в день расходы доходят до $756, а в пиковые дни могут взлететь до $720 (при 80 млн токенов). Перевод вычислений с дата‑центра на ноутбук меняет структуру расходов: вместо постоянных OPEX появляется единовременный CAPEX, а переменные затраты сводятся к стоимости электроэнергии.

Технически компромисс очевиден: ноутбук обрабатывает запросы последовательно, тогда как облако обслуживает тысячи одновременных запросов. Для большинства SMB задачи вроде черновиков писем, резюме или генерации кода работают в «один‑за‑раз» режиме – очереди можно планировать на ночные часы, тяжёлые сценарии распределять во времени.

Почему это важно: переменные затраты на AI падают до уровня электроэнергии, а зависимость от сторонних провайдеров исчезает. CEO среднего бизнеса получает сигнал: инвестировать в ноутбуки‑серверы, сократить OPEX на облачные API и перенести повторяющиеся задачи в локальную среду.